天体生物学中也有和“智能”相关的话题。未来,像人类一样的机器智能是否会在宇宙中随处可见?我们是否仅是昙花一现的演化产物,我们的聪明才智会否带领我们走向灭亡?我们那由熵驱动的、不断制造繁复的宇宙,是否终将与智能相辐合?

这都是些好问题。还有一个问题也值得追问:我们是否能够复制自己的智能,或是做一些与之类似的事?这么做是否明智?

最近几个月,这一话题又出现在大众媒体的报道上。斯蒂芬·霍金(Stephen Hawking)和伊隆·马斯克(Elon Musk)相继发声,最近连比尔·盖茨(Bill Gates)也开始谈论这件事。这些聪明人都觉得我们应该谨慎对待人工智能(Artificial Intelligence,缩写为AI)的发展,否则,它可能会对人类的生存形成威胁。

尽管我们很难搞清他们预测的“生存威胁”具体为何,但霍金指出,强大的人工智能系统可能比生物系统进化得快得-多得-多得-多,它将疯狂地掠夺资源,最终无视人类的生存。我觉得他说的有道理。人工智能的威胁不在于其残暴与狂妄(除非我们故意或者不小心将它变成那样),而在于它会遵循自身的规律演化。我们当然可以假想,人类的安保系统会向人工智能植入“同理心”(empathy,也译“共情”,指一种站在对方立场、设身处地为其思考的方式)。但我觉得,这种想法有两个弱点。其一,大多数人类都有同理心,但我们仍旧可以野蛮残暴地对对待同类以及生活在这颗星球上的其他生灵;其二,我并不确定真正并且强大的人工智能系统可以由人类步步“驯化”而来,我们可能得让它自己发展出智能。

这意味着什么呢?现今人工智能的“深度学习”会使用算法生成自己的概率规则,凭此在大量信息中进行筛选。我们并不需要提前将相应的规则“告知”软件,相反,规则是软件通过自身的算法习得的;或者,软件具有一定的依从性,能被顺利地引向规则。人类就是这么处理语言的。这一过程奇妙得无与伦比,但若人工智能如此行事,是否也能获得和人类一样的效果?怀疑派的诺姆·乔姆斯基(Noam Chomsky)与支持派的彼得·诺维格(Peter Norvig)曾就此激烈争论过。从深层次上看,这是两个科学派别的对峙,其中一派主张内在的简约,另一派则认为自然根本就不简单。

这里我要提出另一种有关人工智能的主张(这并非是我原创)。我们也许可以创造一种孕育智能的普遍条件。这看来滑稽,像是将零部件扔在一个盒子里,等待其自行组装成一辆崭新的自行车。当然,这并非以一种不科学的方式来对待人工智能。但是,倘若“智能”是演化历程中突然出现的一种非常复杂的系统,“人工的智能”还有诞生的机会吗?也许是有的。工程学为此面临的挑战之一,是要制造一个像人脑一样的复杂系统,以支撑智能的存在与运转。但显然,我们的大脑与智力是一同演进出来的。我们并不知道这一复杂系统的确切模样,所以,妄想坐在桌子前设计出一种可以催生出新型智能的系统,未免有点蠢。

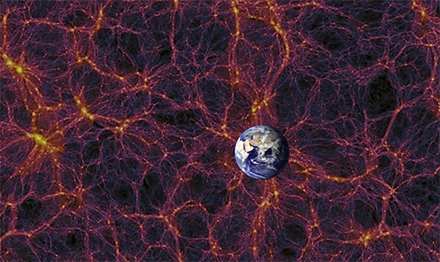

但如果我们现在已经开始为这一系统设置条件,情况就不一样了。“机器学习”大概就是人工智能所需要的“行为学”,但身处互联网的汪洋中,今天它该何去何从呢?大数据、小数据、应用软件、掌握数据包传送的算法、传感器(从GPS到恒温装置,再到流量管理器),都能直接或间接地互相交流。

这就像一个巨大的施工现场。据估计,2014年互联网上的移动设备数量达到了74亿。如果对所有能够接入互联网的东西进行统计——从马桶到工厂等一切能够并入物联网的东西,据估计,现今互联网上的活跃链接多达150亿(数据来自思科公司提供的一项非常有爱的服务),而到2020年时,这一数据将达到500亿。

如果孕育人工智能的盒子里全是杂乱无章的数据,这个盒子恐怕也没什么魔力。但我们的盒子不是杂乱无章的。盒子里已经有了越来越多的算法,可以在数据的汪洋中找出结构和联系。这一设计,部分是受到了生物智能的启发,或者至少来自我们目前对“生物智能”的粗浅认识。代码与代码互相交流,数据包为寻找最佳的路径四处游逛,软件可以与硬件沟通,硬件之间也能互相沟通。这套生态系统之上,还有人脑对信息进出的维护。日复一日,这些“相互交流”,自己就会令数据的汪洋产生巨大的改变,它们就像分析师一样,能够从以往的规律中“了解”我们——无论作为个体或是群体——下一步的打算。

这样一套系统是否足以孕育出一种高级人工智能的类似物?我不太清楚,其他人也不知道。但在自生命出现以来的40亿年间,这样的问题还是头一次出现,这也使我们重新回到“人工智能威胁论”。

如果这真能催生出一个强大的人工智能,我们当头的威胁,将产生于如今人们对互联网生态的强力依赖。这不仅关乎我们沟通以及获取信息的方式,它也决定了我们的食物供给系统的组织形态、决定了药师如何追踪药物的流向,同时也决定了我们的飞机、火车、卡车和轮船的时刻表,以及金融系统的运作。这样的人工智能系统会像小孩打乱你装袜子的抽屉或者咬猫咪的尾巴一样造成灾难。

霍金认为人工智能会迅速演化。事实上,它可以在不到一秒的时间内完成“出现-演化-破坏互联网系统”的全过程。这也会使我们看到一个有趣的怪圈:一个“偶发”的人工智能竟无法建立任何长期生存所需的虚拟连接与结构,而是以迅雷不及掩耳之势作茧自缚。这是人工智能的短板,于我们却是安慰。

我很难不将这与另一个古老的问题——费米悖论(Fermi Paradox)联系起来。人工智能的产生或许将是一次灭绝文明的大筛选(Great Filter),但它也会自我终结,这大概也是人工智能无法在过去的130亿年里跨越星系与我们相见的主要原因吧。

(作者:卡莱布·施拉夫,哥伦比亚大学多学科天体生物学中心主任;翻译:张栎文)

评论列表(条(包括审核中))